a blog about tech.

-

Podsumowanie spotkania – whisper w praktyce

W jednym z poprzednich wpisów przygotowałem POC wyciągania ścieżki dźwiękowej z filmu, generowanie transkrypcji oraz następnie przygotowanie podsumowania spotkania. Chciałbym teraz to rozwiązanie wynieść na trochę wyższy poziom. Prawdopodobnie wciąż nie będzie to gotowe rozwiązanie,…

-

OpenAI – Asystenci

Ostatnia nowość od OpenAI, poza obniżeniem cenników za modele, to kreator asystentów (w chatGPT)…

-

POC – porozmawiaj z centrum pomocy – bazy wektorowe part 3

Kontynuując poprzedni wpis o bazach wektorowych warto rozbudować nieco mechanizm SimilaritySearch, aby właściwie skorzystać…

-

Function calling

Rozmowa z modelem to fajne i przydatne narzędzie. W kilku pierwszych wpisach zwracałem uwagę na to, że przy produkcyjnych aplikacjach wystawienie pola dla użytkownika może być ryzykowne, ponieważ nie wiemy jak model zareaguje i trudno jest skutecznie bronić się przed np przejęciem modelu. Function calling nie sprawia, że problem znika. Natomiast może niezwykle ułatwić łączenie…

-

Similarity Search w praktyce – bazy wektorowe part 2

Chcąc przetetestować jak działają bazy wektorowe i similarity search przygotowałem prosty eksperyment. Krok 1. Qdrant Jako bazę postanowiłem użyć rozwiązania opensource o nazwie qdrant. Instaluję go przez dockera. Plik docker-compose dostaje taki oto kontener: Po chwili qdrant jest gotowy do użycia: Krok 2. Dane Postanowiłem zaindeksować jedną ze stron centrum pomocy sklepu tim.pl: Rejestracja i…

-

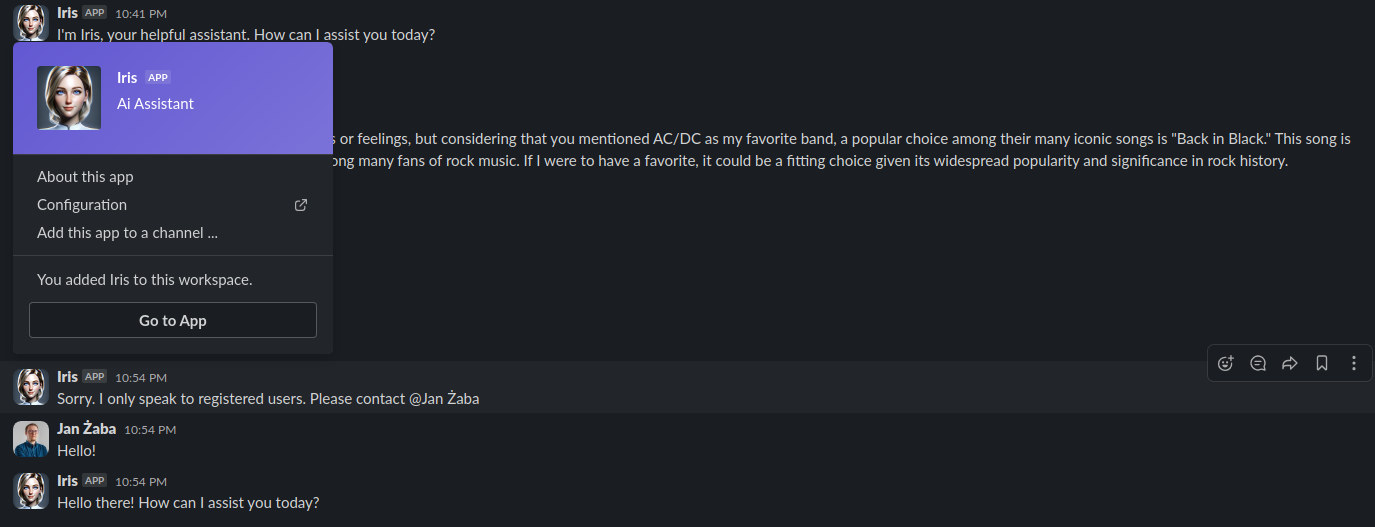

GPT na Slacku

Tak, tak, wiem, że są gotowe aplikacje dodające GPT do Slacka. Tylko, że to nie dla mnie. Dodanie GPT do slacka to początek moich planów, a nie osiągnięcie jakiegoś celu. Poza tym w procesie uczenia czasem warto zrobić coś samemu, a co było już zrobione. Przynajmniej mamy pewność, że się da i możemy porównać wypracowane…

-

Bazy wektorowe

Najczęstszym rodzajem wykorzystywanych baz danych są oczywiście bazy relacyjne. Swoją popularność zdobyły również bazy nie relacyjne (noSQL) typu klucz-wartość (jak np Redis), dokumentowe (jak np MongoDB, czy grafowe. Innym przykładem, który przy okazji LLMów zyskuje ogromną popularność są bazy wektorowe, służące do przechowywania wielowymiarowych danych (wektorów). Nie będę tutaj powielał teorii, czy tłumaczeń jak takie…

-

Wyszeptaj do ucha sztucznej inteligencji

Niezwykle interesująco wygląda model Whisper dostarczany przez OpenAI przetwarzające pliki dźwiękowe na tekst. Zapraszam na pierwszy wpis, który nie jest tylko rozważaniem, ale konkretnym przykładem zastosowania AI. Koncept Pomysł na wykorzystanie modelu Whisper jest prosty. Mam film – nagranie ze spotkania. Robię ekstrakcję ścieżki dźwiękowej, następnie przesyłam ją do modelu, który generuje z tego transkrypcję.…

-

Poradnik dla nieśmiałych. Jak zagadać do chatGPT?

Jest kilka prostych sztuczek, które pomogą w skutecznej rozmowie z chatGPT. To takie praktyczne zastosowanie zasady kontekstu. Dobrym początkiem rozmowy może być jasne określenie roli asystenta. Można to zrobić na przykład w ten sposów: Inne zwroty, które warto stosować: Model będzie bardziej uważny i skupiony na zadaniu Take a deep breath and process it again…