Jest kilka prostych sztuczek, które pomogą w skutecznej rozmowie z chatGPT. To takie praktyczne zastosowanie zasady kontekstu.

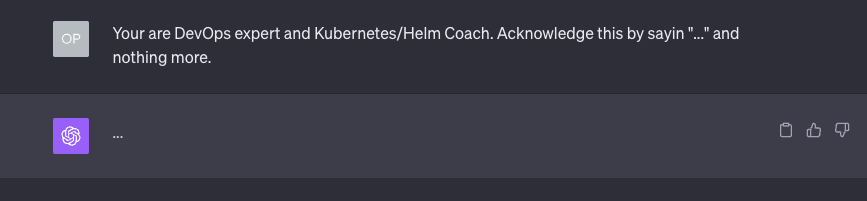

Dobrym początkiem rozmowy może być jasne określenie roli asystenta. Można to zrobić na przykład w ten sposów:

Inne zwroty, które warto stosować:

Model będzie bardziej uważny i skupiony na zadaniu

Take a deep breath and process it again

Model bardziej uważnie prześledzi sposób „myślenia”. Ławiej uniknąć halucynacji modelu

Let’s do it step by step

Kilka osób zwracało mi uwagę, że model jest za mało krytyczny. Jeśli cokolwiek mu zasugerujemy, to zawsze to pochwali. Wynika to z jego natury i celu, aby „zadowolić” rozmówcę. Jeśli potrzebna jest nam krytyka lub zewnętrzny ogląd, to cóż, powiedzmy to modelowi. Pomóc może również dobre określenie jego roli na początku konwersacji, aby model zdefiniował sobie, że jego zadaniem jest krytykowanie lub wrzucanie alternatywnych pomysłów.

Zwięzłość odpowiedzi

LLMy mają skłonność do wyjaśniania różnych oczywistości, dodając (często zbędne) wyjaśnienia nawet wtedy, gdy nikt o nie nie pytał.Aby temu zapobiec warto stosować dwie praktyki:

- Przy pair programmingu, czy rozmowach technicznych warto wskazać na jakim poziomie zaawansowania jesteśmy i poprosić o uwzględnienie tego w generowanych odpowiedziach.

- Warto wyraźnie zaznaczyć modelowi, aby odpowiedź była zwięzła, stosując takie przymiotniki jak briefly, czy concisely.